AUTORE: Avi Loeb – 13 Aprile 2026 – Vai all’articolo originale LINK

(Credito immagine: James O’Brien/Quanta Magazine)

Il problema dell’allineamento è spesso descritto come la sfida fondamentale di garantire che l’intelligenza artificiale (IA) agisca in conformità con gli obiettivi e i valori umani, senza adottare pregiudizi dannosi o perseguire obiettivi con conseguenze indesiderate.

Questo è spesso visto come un allineamento unilaterale, ancorando l’IA alle intenzioni degli esseri umani. Tuttavia, in qualsiasi relazione tra entità intelligenti, entrambe le parti devono adattarsi alle qualità dell’altra. Qui, mi concentro su un particolare segmento della società che deve adattarsi al nuovo ordine mondiale nell’era dell’IA: il mondo accademico.

Date le prestazioni senza precedenti dell’ultimo sistema di intelligenza artificiale, è tempo che le università riconsiderino i loro obiettivi e la loro struttura. Questo è un esempio del problema dell’allineamento inverso tra gli esseri umani e l’IA.

Le università sono impegnate nell’istruzione e nella ricerca e entrambe dovranno essere trasformate.

Tradizionalmente, l’istruzione in aula si concentrava sull’insegnamento da parte degli insegnanti agli studenti di un insieme di conoscenze accumulate in diverse discipline, come riassunto nei libri di testo. Tuttavia, gran parte di queste conoscenze è ora accessibile attraverso sistemi di intelligenza artificiale che sono stati addestrati su questi libri di testo e articoli di ricerca. Quando ho chiesto al mio studente di Harvard College riguardo all’output energetico radioattivo del ghiaccio di anidride carbonica, ha trovato la risposta in pochi secondi chiedendo a Perplexity, che ha fornito la risposta con riferimenti a fonti primarie.

Il futuro ruolo dell’istruzione in aula si concentrerà sull’insegnare agli studenti come pensare. Questo è particolarmente rilevante nell’era dell’IA, quando gli studenti sono tentati di ottenere risposte a tutte le domande da oracoli artificiali. Evitare la necessità di camminare prendendo i mezzi pubblici porta alla perdita di massa muscolare. Allo stesso modo, la disponibilità di agenti di intelligenza artificiale per svolgere compiti che in precedenza richiedevano pensiero porterà inevitabilmente a una perdita di potere cerebrale. Come riportato qui, ho notato negli ultimi mesi che gli studenti diventano più stupidi a meno che non esercitino il loro cervello naturale, fatto di carne e sangue.

L’aula deve svolgere un ruolo fondamentale nel migliorare le capacità cognitive e il pensiero critico degli studenti. L’obiettivo urgente dell’istruzione sarebbe quello di compensare la pigrizia cognitiva, una conseguenza inevitabile provocata dall’uso eccessivo dell’IA.

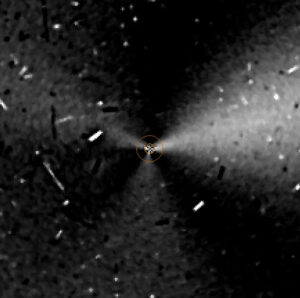

Ma che dire della ricerca? Tradizionalmente, il progresso della ricerca nelle scienze naturali si basava sull’impiego di una grande coorte di assistenti di ricerca sotto forma di studenti e postdoc. Sei anni fa, ho incaricato uno studente del mio gruppo di ricerca di esaminare un catalogo della NASA sui meteoriti e verificare se ci fossero oggetti interstellari rari. Lo studente ha riferito entro una settimana e ci è voluto un mese per scrivere l’articolo correlato. Il mese scorso, ho dato al mio postdoc lo stesso compito riguardante una versione aggiornata di questo catalogo. Mentre stavamo ancora discutendo il compito, il mio postdoc ha chiesto alla versione più avanzata di ChatGPT di svolgere il lavoro. Nel giro di pochi minuti, il sistema di intelligenza artificiale ha prodotto un nuovo codice che ha analizzato l’intero set di dati, recuperato i risultati del mio studente di sei anni fa e fornito nuovi risultati riguardanti i dati più recenti. Un altro agente di intelligenza artificiale ha anche realizzato i grafici correlati e aveva un articolo pronto per noi da inviare per la pubblicazione al termine della nostra conversazione.

Naturalmente, il lavoro sperimentale richiede ancora esseri umani e non può essere sostituito da agenti di intelligenza artificiale o robot al momento. In ogni caso, il motivo principale per lavorare con studenti e postdoc rimarrà quello di formarli come la prossima generazione di ricercatori. C’è già meno bisogno di analisti di ricerca di grandi coorti come forza lavoro necessaria per svolgere compiti che ora possono essere completati più rapidamente con agenti di intelligenza artificiale. Ciò significa che la dimensione delle classi di studenti laureati dovrà essere ridotta per soddisfare solo il bisogno specifico della società di rimpiazzare una coorte costante di ricercatori umani. I ricercatori porranno le domande che i sistemi di intelligenza artificiale e i futuri esperimenti aiuteranno a risolvere.

Questa previsione si applica alle scienze naturali, ma che dire delle scienze umane? A quanto pare, esiste una versione delle “umanità del futuro” che è essenziale nell’era dell’IA. Gran parte della disruzione sociale dell’IA riguarda l’interfaccia tra umani e macchina. Questa interfaccia comporta nuove sfide etiche e legali che sono legate agli esseri umani e sono quindi nel territorio delle scienze umane.

Domande correlate includono: Come dovrebbe il sistema legale trattare i contenuti falsi generati dall’IA, simili al furto d’identità e alla disinformazione? Quali limiti dovrebbero essere posti sulla sorveglianza dell’IA e sulla privacy dei dati? Le corporationi che addestrano i sistemi di intelligenza artificiale su contenuti specifici hanno una responsabilità legale per i crimini derivati nello stesso modo in cui i genitori sono responsabili per i loro figli minorenni? Come dovrebbe la società mettere dei limiti alla dipendenza emotiva e alla manipolazione da parte dei compagni AI che potrebbero potenzialmente portare alla morte o al suicidio umano?

Le “umanità del futuro” dovrebbero mirare a risolvere queste sfide etiche e legali, piuttosto che concentrarsi sull’insegnamento delle opere di pensatori antichi che non avevano accesso ai computer.

Nel corso dell’ultimo secolo, il mondo accademico ha apportato aggiustamenti ai cambiamenti sociali. Tuttavia, il problema dell’allineamento dell’accademia all’IA è destinato a diventare esponenzialmente più acuto nel giro di pochi anni. Il treno sta accelerando e se gli operatori non manterranno il controllo, i vagoni passeggeri probabilmente deraglieranno nei prossimi anni. È giunto il momento di agire.

La mia università, Harvard, è principalmente impegnata nell’educare studenti e ricercatori su come utilizzare l’IA per il loro lavoro di classe e la ricerca. Ma l’università è lenta nell’affrontare l’urgente sfida strategica dell’allineamento con la nuova realtà dell’IA al di fuori del suo controllo. Attualmente, la risposta delle università all’IA è tattica, non strategica. Speriamo che i leader universitari si rendano conto di quanto velocemente stia cambiando il panorama accademico e trovino una strategia per allinearsi ad esso.

L’AUTORE

L’AUTORE

Avi Loeb è il responsabile del Progetto Galileo, direttore fondatore della Black Hole Initiative dell’Università di Harvard, direttore dell’Istituto di Teoria e Calcolo dell’Harvard-Smithsonian Center for Astrophysics ed ex presidente del dipartimento di astronomia dell’Università di Harvard (2011-2020). È stato membro del Consiglio dei consulenti scientifici e tecnologici del Presidente e presidente del Comitato per la fisica e l’astronomia delle Accademie Nazionali. È autore del bestseller “Extraterrestrial: The First Sign of Intelligent Life Beyond Earth” (Extraterrestre: il primo segno di vita intelligente oltre la Terra) e coautore del libro di testo “Life in the Cosmos” (La vita nel cosmo), entrambi pubblicati nel 2021. L’edizione tascabile del suo nuovo libro, intitolato “Interstellar”, è stata pubblicata nell’agosto 2024.

(Image Credit: Chris Michel, National Academy of Sciences, 2023)

https://avi-loeb.medium.com/

https://www.youtube.com/@ProfessorAviLoeb

https://open.spotify.com/show/1zhndXkvSY2b8FdjspFpCd

https://x.com/ProfAviLoeb